Нейро-Токаев, поддельные полицейские и порно: как распознать дипфейки

Прогресс не стоит на месте, технологии постоянно развиваются, но вместе с ним растёт и арсенал, который используют мошенники для обмана потенциальных жертв. И если раньше считалось, что на уловки аферистов ведутся только доверчивые люди, то сейчас виртуальный обман вышел на новый уровень, и в сети злоумышленников попадаются даже самые прокачанные. Редакция Orda.kz разобралась, что такое дипфейк и как распознать подделку.

Дипфейк — реалистичная подмена фото-, аудио- и видеоматериалов, созданная с помощью нейросетей. Считается, что впервые технология появилась в 2014 году. С тех пор она постоянно развивалась и дорабатывалась, последние продукты на её основе способны обрабатывать изображение в режиме реального времени, накладывая на ваше лицо «маску» в виде чужого лица. Это работает так же просто, как любой из доступных фильтров в Instagram или TikTok.

И, как всегда, у технологии есть две стороны: она может работать на пользу цифровому искусству, «воскрешать» давно погибших культовых актёров, использоваться для создания юмористических скетчей или даже в медицине — к примеру, в цифровой косметологии, которая сейчас зарождается в Южной Корее. Также дипфейк помогает синтезировать искусственные голоса, которые значительно снижают расходы на рекламу для малого бизнеса.

Но, как упоминалось выше, есть и обратная сторона. Появляются новые мошеннические схемы. Киберпреступники могут подделывать голоса, накладывать лицо знаменитостей и близких вам людей на своё, снимать фейковые видеоролики.

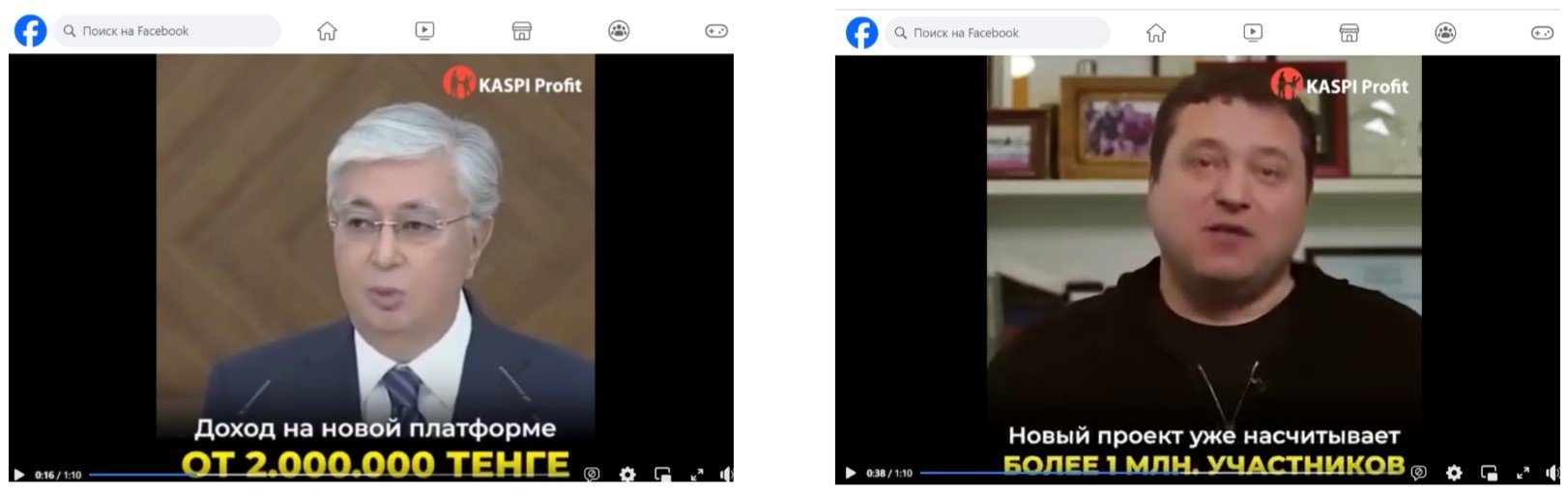

В сентябре 2023 года в соцсетях распространялось видео, в котором президент Казахстана Касым-Жомарт Токаев якобы призывал граждан вкладываться в новую инвестиционную платформу Илона Маска. Оказалось, что ролик создали с помощью искусственного интеллекта.

Похожая ситуация произошла в конце октября, когда распространялась реклама с фальшивой озвучкой Касым-Жомарта Токаева. В ролике используется видеоряд, в котором он якобы рассказывает о «новом проекте для казахстанцев». В нём идёт речь о проекте TON, который разработал предприниматель Павел Дуров.

Уже в этом году в Сети появился очередной дипфейк с участием президента Токаева. На видео глава государства обещает вернуть деньги всем, кто пострадал от мошеннических схем. Якобы специально для этого президент создал компанию «Қазақстан халқына». Поддельный президент просил перейти по ссылке на специальный сайт. Злоумышленники отправили рекламу с фишинговым сайтом с одной целью — выманить средства у доверчивых казахстанцев.

И не только президент под прицелом. В подобных роликах периодически используют лица глав Нацбанка (как бывших, так и нынешних) и Министерства финансов.

В апреле 2024 года пресс-служба департамента полиции Карагандинской области распространила фото мошенников в форме полицейских, которые звонят казахстанцам и обманывают их. Фейковые сотрудники полиции накладывали поверх своих лиц лица голливудских звёзд (и Илона Маска) и на фоне имитации служебных кабинетов звонили казахстанцам в WhatsApp.

Также в интернете распространяются фейковые порноизображения и ролики, сделанные при помощи ИИ-технологий и с использованием фото реальных людей. Мишенью злоумышленников, как правило, становятся женщины. Несколько знаменитостей уже пострадали — например, в 2022 году неизвестные выпустили десятки видеороликов для взрослых, используя лица актрис Дженнифер Лоуренс и Анны Де Армас. Голливудские юристы отмечают, что в будущем это может перерасти в настоящую эпидемию виртуальной секс-эксплуатации.

Принцип работы и как распознать фальшивку

«Технология дипфейк основана на использовании методов машинного обучения и искусственного интеллекта, в частности, генеративно-состязательных сетей (GAN). Эти сети работают следующим образом: одна сеть (генератор) создаёт поддельные изображения или видео, а другая сеть (дискриминатор) пытается отличить их от реальных. Обе сети обучаются вместе, улучшая свои результаты на каждом шагу», рассказал основатель компании Nitro Team Батыржан Тютеев.

По его словам, освоение технологии дипфейк требует определённых знаний в области машинного обучения, нейронных сетей и программирования. Для этого нужно понимать основы и уметь работать с библиотеками машинного обучения, такими как TensorFlow или PyTorch.

Существуют готовые решения и инструменты, такие как ROOP, которые позволяют создавать дипфейки даже пользователям с базовыми знаниями в области ИТ.

Он отметил, что мошенники используют технологию дипфейк в различных целях:

- Социальная инженерия: создание поддельных видео или аудио для манипуляции людьми.

- Финансовые мошенничества: поддельные видео от лица руководителей компаний для инициирования незаконных транзакций.

- Политическая дезинформация: создание фальшивых новостей или высказываний политиков для влияния на общественное мнение.

- Подставы: организация подстав, уличающих людей в действиях, которых они не совершали, что может серьёзно повредить их репутации.

Тютеев подчеркнул, что распознать использование технологии дипфейк может быть сложно, но есть несколько признаков, на которые стоит обратить внимание:

- Аномалии в мимике: нереалистичные движения губ или глаз.

- Несоответствие звука и изображения: задержка или рассинхронизация аудио и видео.

- Искажения изображения: артефакты, размытости или изменения в освещении, которые выглядят неестественно.

«Для обывателей существуют инструменты и приложения, которые помогают определить подлинность видео, такие как Deepware Scanner или InVID. Эти инструменты анализируют видеоматериалы и помогают выявить возможные фальсификации», рассказал эксперт.

Он добавил, что в будущем количество мошеннических инцидентов с использованием технологии дипфейк только увеличится.

«С развитием технологий машинного обучения и доступностью мощных вычислительных ресурсов создание дипфейков становится всё проще и доступнее. Это означает, что злоумышленники будут всё чаще использовать эту технологию для достижения своих целей. Поэтому важно, чтобы специалисты по информационной безопасности и обычные пользователи были в курсе новейших методов обнаружения и защиты от подобных угроз», резюмировал Тютеев.

Читайте также:

Лента новостей

- Какие ЖК в Алматы рискуют остаться без света с 8 июня из-за долгов

- «Ещё немного — и всё рухнет»: жители Туркестанской области боятся лишиться жилья из-за грунтовых вод

- «Пока не вижу смысла»: Путин ответил на предложение Зеленского о встрече

- После убийства девушки в Кызылординской области заговорили о маньяке

- В Семее отметили Всемирный день окружающей среды и День эколога

- Ещё одну партию редких лошадей доставили в Казахстан

- Несвоевременные выплаты пенсий и пособий отнесут к грубым нарушениям

- Бургеры, пицца и суши на миллиарды: казахстанцы почти вдвое увеличили расходы на доставку еды

- «Начни с себя»: в Астане запустили экочеллендж в поддержку бережного отношения к природе

- КНБ проверили Нурлана Сабурова на финансирование ЧВК «Вагнер»

- Когда уйдёт беда с разбитой дорогой? В центре Актобе пенсионерка получила серьёзную травму

- В Астане наградили активистов экологической сферы

- MG от Allur запускает новую финансовую программу «Таза пайда: гибкий платеж»

- Судьба легендарной алматинской Совминки решена: что построят на месте старых корпусов

- В армии Казахстана меняют призыв? Кого заберёт система с искусственным интеллектом

- Водителя, тащившего за автомобилем телёнка в ВКО, наказали. Видео

- Вывезли по-тихому? Гражданина Беларуси экстрадировали из Казахстана после заявления о насилии

- Арочные окна и лепнина вместо сайдинга: в Алматы взялись за старые фасады

- Силовики нашли нелегальную базу данных почти на всех казахстанцев в области Жетысу

- Нацбанк дал совет для держателей депозитов